還不會使用 Tansor.Art?先看看教學文章:Tensor Art 教學:目前最推薦的免費網頁版 AI 繪圖工具!

Tensor Art:https://tensor.art/

什麼是ControlNet?

Stable Diffusion 的 ControlNet 是一種增強技術,旨在提升生成模型在生成圖像時的控制能力。Stable Diffusion 是一種基於擴散模型的圖像生成技術,能夠從隨機噪聲中逐步生成高品質的圖像。ControlNet 在此基礎上增加了控制機制,使用戶能夠在生成圖像時施加更多的約束和指導,從而生成更符合預期的結果。

ControlNet 透過引入額外的輸入資訊(如草圖、邊緣圖、文字描述等),對擴散過程中的每一步進行引導。這種引導可以幫助模型更好地理解用戶的意圖,從而在生成圖像時更加精確地滿足用戶的需求。具體來說,ControlNet 可以在以下幾個方面提供控制:

- 形狀控制:透過輸入草圖或邊緣圖,用戶可以控制生成圖像的基本形狀和結構。

- 風格控制:透過輸入參考圖像,用戶可以控制生成圖像的風格,使其與參考圖像相似。

- 內容控制:透過輸入文字描述,用戶可以控制生成圖像的內容,使其符合文字描述的內容。

這種控制機制使得生成圖像的過程更加靈活和可控,適用於需要精確圖像生成的各種應用場景,如藝術創作、設計輔助和廣告製作等。

總結來說,ControlNet是一種增強技術,透過引入額外的控制輸入,使生成模型在生成圖像時能夠更加精確地滿足用戶的需求,從而生成更加符合預期的高品質圖像。

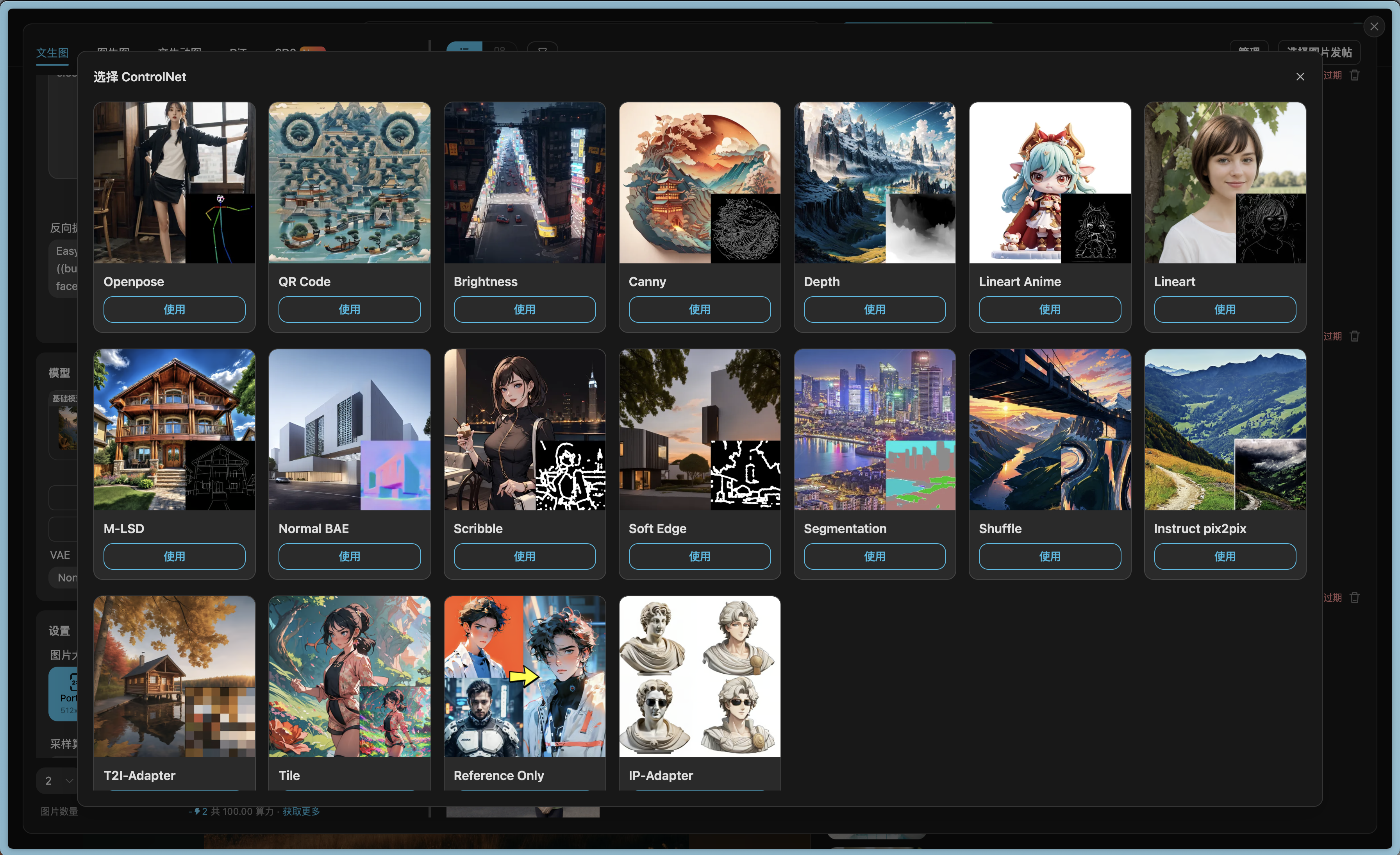

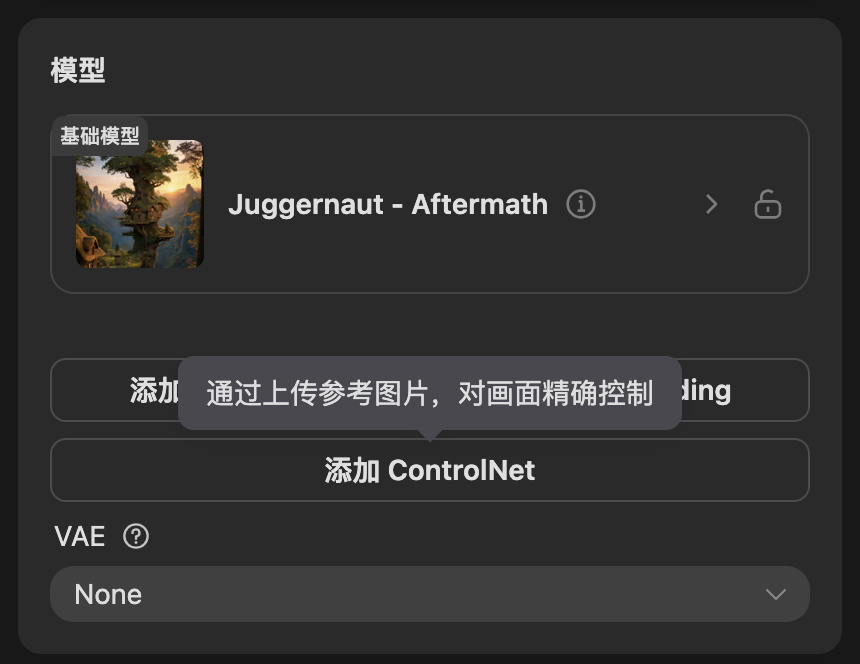

在 Tensor.Art 總共有 18 個 ControlNet 模型,根據不同算圖模型,可以使用的 ControlNet 模型數量不一,我們會挑幾個較常使用的介紹並教學,今天先介紹 OpenPose 與 Reference 模型!

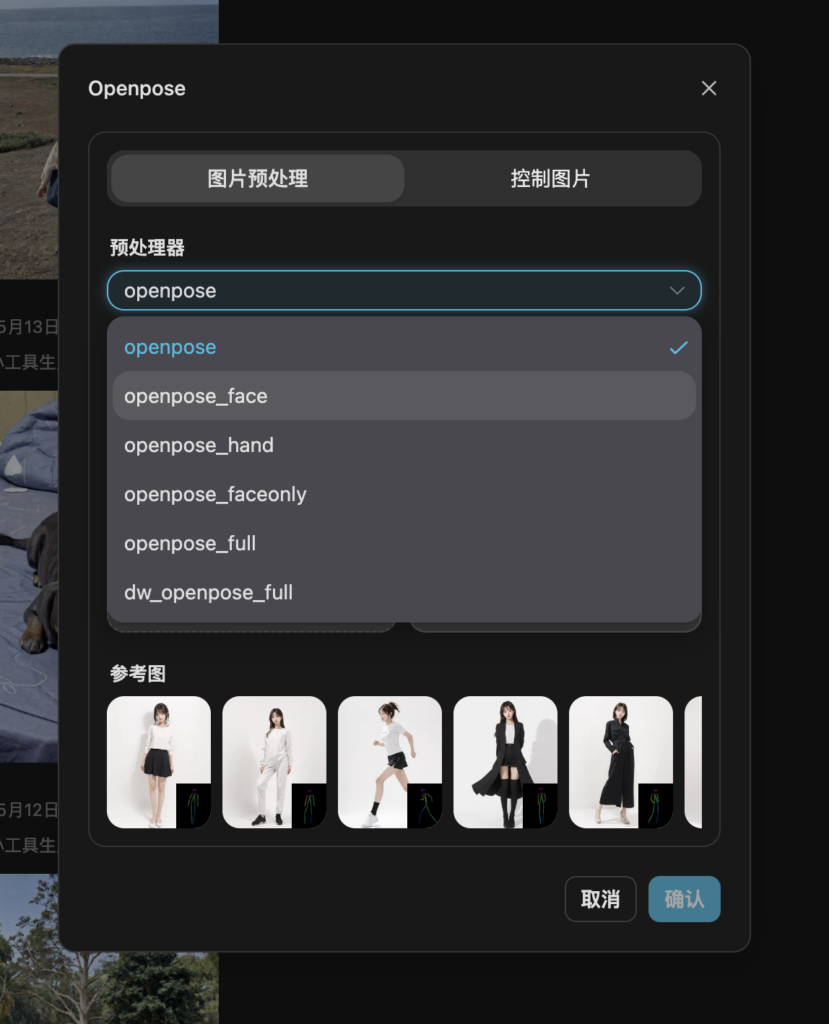

OpenPose 模型

有多個 OpenPose 預處理器。

OpenPose 檢測人體關鍵點,例如頭部、肩膀、手部等位置。它可用於複製人體姿勢,而無需複製其他細節,例如服裝、髮型和背景。

所有 openpose 預處理器都需要與 ControlNet 的 Model 下拉功能表中的 openpose 模型一起使用。

OpenPose 預處理器包括:

- OpenPose:眼睛、鼻子、眼睛、脖子、肩膀、肘部、手腕、膝蓋和腳踝。

- OpenPose_face:OpenPose + 面部細節

- OpenPose_hand:OpenPose + 手和手指

- OpenPose_faceonly:僅面部細節

- OpenPose_full:以上所有

- dw_openPose_full:OpenPose_full 的增強版本(使用 Dw OpenPose 提取所有細節。)

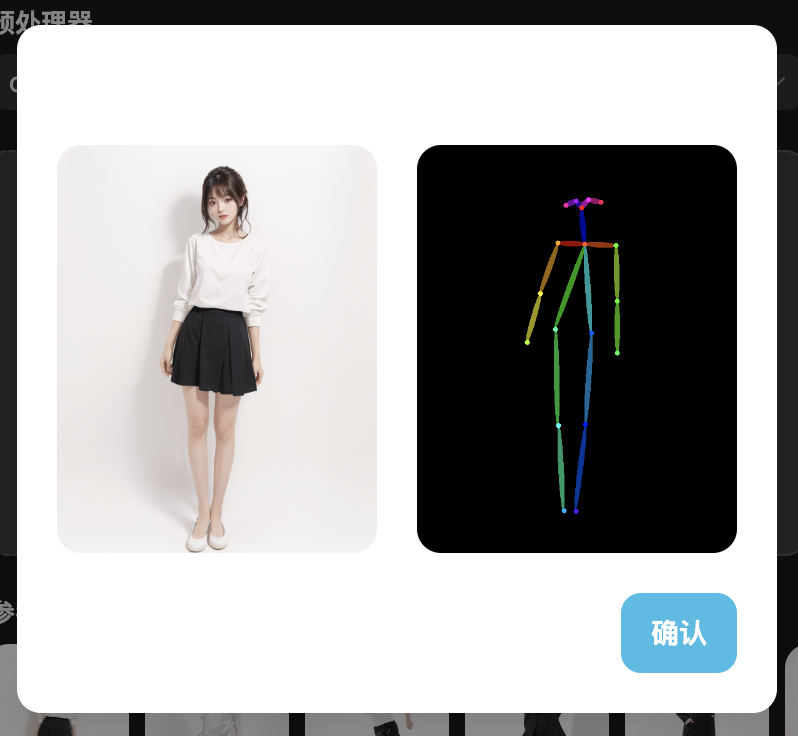

OpenPose

OpenPose 是基本的 OpenPose 預處理器,可檢測眼睛、鼻子、眼睛、頸部、肩部、肘部、手腕、膝蓋和腳踝的位置。

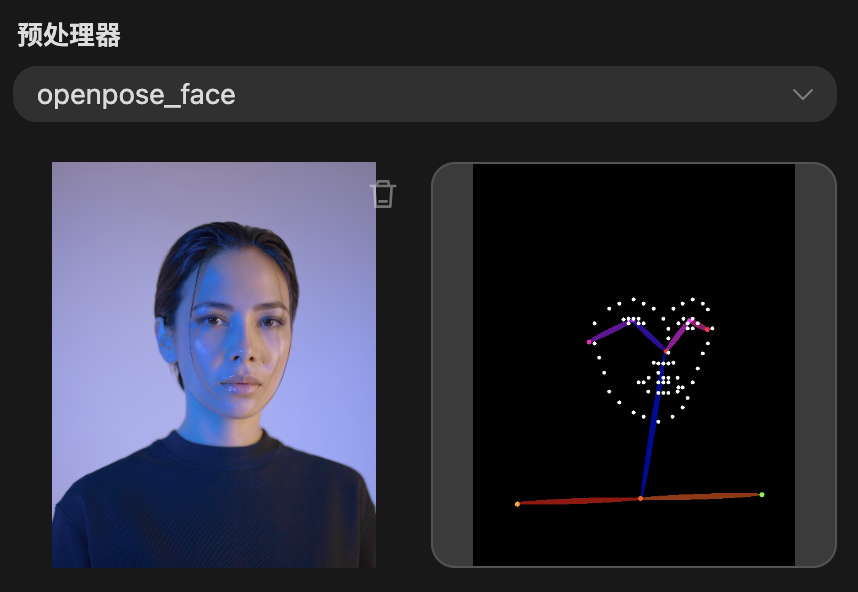

OpenPose_face

OpenPose_face 完成 OpenPose 處理器所做的一切,但會檢測額外的面部細節。

它對於複製面部表情很有用。

範例圖像:

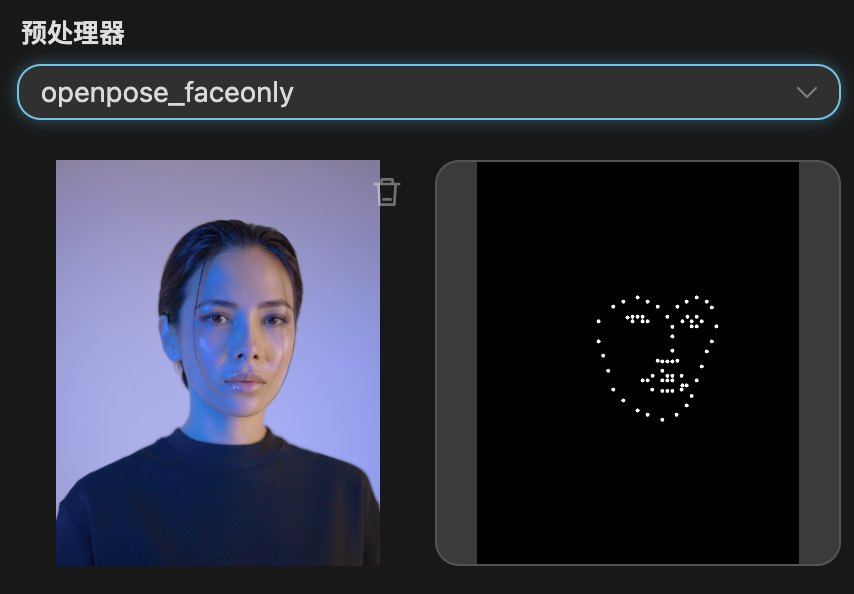

OpenPose_faceonly

OpenPose 人臉僅檢測人臉,而不檢測其他關鍵點,這對於僅複製人臉而不適用於其他關鍵點,身體不受約束。

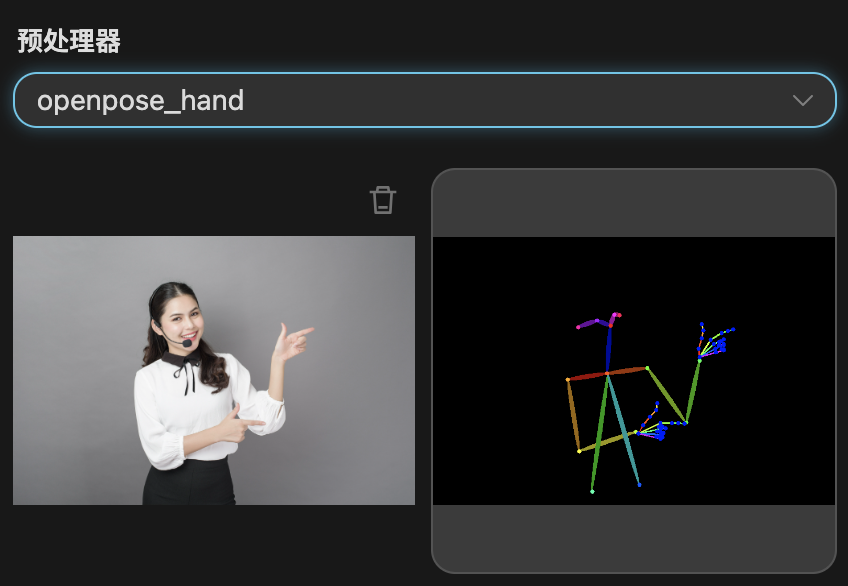

OpenPose_hand

OpenPose_hand 將關鍵點檢測為 OpenPose 以及手和手指。

範例圖片:

OpenPose_full

OpenPose full 檢測 openPose face 和 openPose hand 所做的一切。

範例圖像:

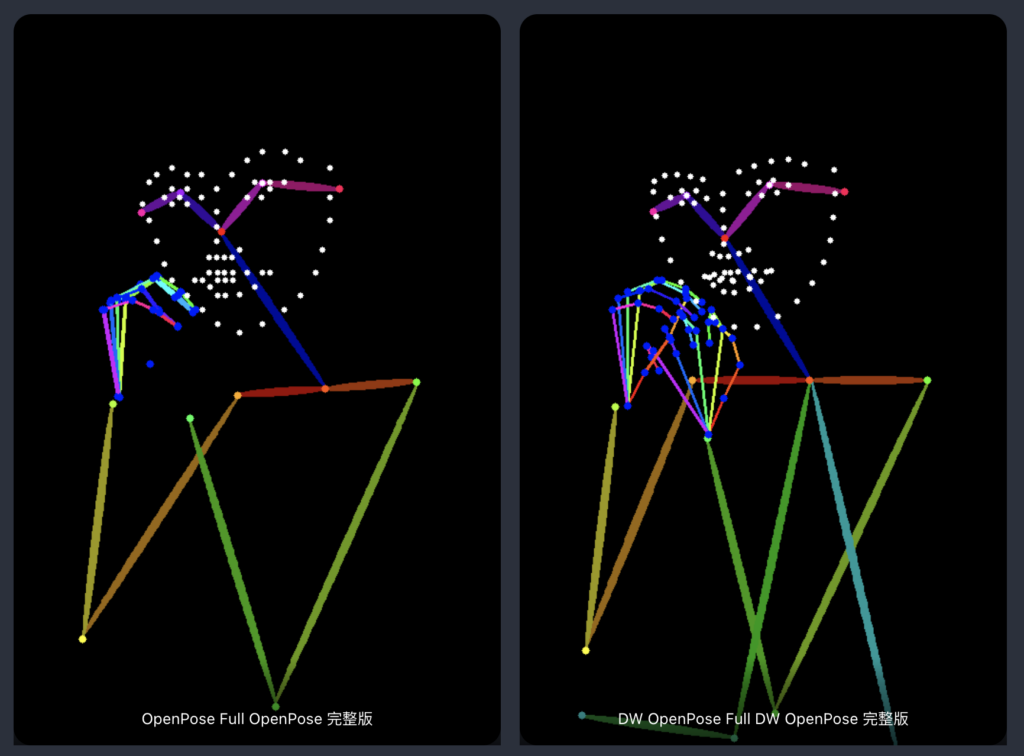

dw_openpose_full

DWPose 是一種基於研究文章 Effective Whole-body Pose Estimation with Two-stage Distillation 的新姿態檢測演算法。它完成了與 OpenPose Full 相同的任務,但做得更好。您應該使用 dw_openpose_full 而不是 openpose_full。

Reference 模型

Reference 是一組預處理器,可用於生成與引用圖像類似的圖像,穩定擴散模型和提示仍將影響圖像。

Reference 預處理器不使用控制模型。您只需要選擇預處理器,而不需要選擇模型。(事實上,在選擇參考預處理器后,模型下拉功能表將被隱藏。)

有 3 個引用預處理器。

- Reference adain:透過自適應實例規範化進行樣式遷移。

- Reference only:將參考圖像直接連結到注意圖層。

- Reference adain+attn:上述組合。

選擇其中一個預處理器以使用。以下為範例:

Prompt:

a woman with pink hair and a robot suit on, with a sci – fi, Artgerm, cyberpunk style, cyberpunk art, retrofuturismReference adain

Reference only

Reference adain+attn

Reference only 的效果感覺最好。

大家可以先去試玩看看這兩個模型唷~!